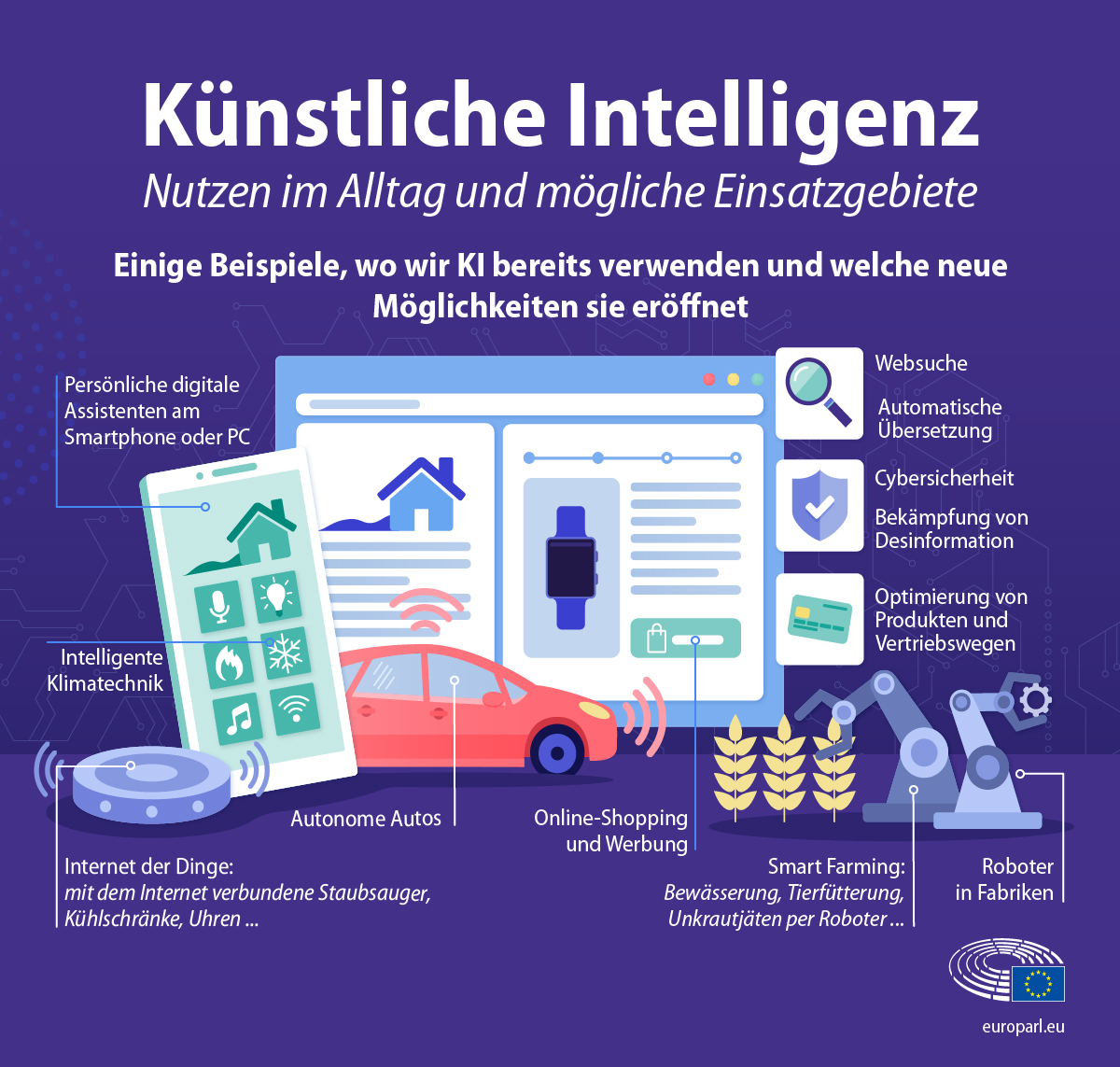

Die Integration von Künstlicher Intelligenz (KI) in verschiedene Bereiche des täglichen Lebens und der Industrie bringt nicht nur technologische Fortschritte, sondern auch zahlreiche rechtliche Herausforderungen und praktische Konsequenzen mit sich. Die rechtlichen Aspekte der KI-Nutzung sind von entscheidender Bedeutung, da sie die Grundlage für eine verantwortungsvolle und ethische Anwendung dieser Technologien bilden. Gleichzeitig haben sie erhebliche Auswirkungen auf die Praxis, sei es in der Wirtschaft, im Gesundheitswesen oder im juristischen Bereich. Um ein umfassendes Verständnis für diese vielschichtigen Themen zu entwickeln, ist es wichtig, sowohl die rechtlichen Rahmenbedingungen als auch die praktischen Herausforderungen zu betrachten.

Rechtliche Herausforderungen durch KI

Die rechtlichen Herausforderungen, die durch den Einsatz von KI-Tools entstehen, sind vielfältig und komplex. Gesetzliche Vorgaben sind notwendig, um den Einsatz von KI zu regulieren und sicherzustellen, dass diese Technologien im Einklang mit bestehenden Rechtsnormen stehen. Ein bedeutendes Beispiel ist die Datenschutz-Grundverordnung (DSGVO) in der Europäischen Union, die strenge Anforderungen an die Verarbeitung personenbezogener Daten stellt. KI-Systeme, die große Mengen an Daten analysieren, müssen diesen Anforderungen entsprechen, um rechtliche Konsequenzen zu vermeiden.

Darüber hinaus werfen KI-Technologien Fragen hinsichtlich der Haftung auf. Wer ist verantwortlich, wenn ein KI-System eine falsche Entscheidung trifft oder Schaden verursacht? Diese und ähnliche Fragen sind noch nicht abschließend geklärt und stellen eine erhebliche Herausforderung für Juristen und Gesetzgeber dar. Laut dem Fortbildungsportal der Ruhr-Universität Bochum sind klare Regelungen notwendig, um Rechtssicherheit zu schaffen und das Vertrauen in KI-Technologien zu stärken.

Ein weiteres zentrales Thema ist die Transparenz und Erklärbarkeit von KI-Entscheidungen. Nutzer und Betroffene müssen nachvollziehen können, wie und warum eine KI zu einer bestimmten Entscheidung gekommen ist. Diese Anforderungen werden in Gesetzgebungsprozessen zunehmend berücksichtigt, wie beispielsweise in der Diskussion um den EU Artificial Intelligence Act, der spezifische Regelungen für den Einsatz von Hochrisiko-KI-Systemen vorsieht.

KI und die juristische Praxis: Chancen und Risiken

Der Einsatz von KI in der juristischen Praxis bietet sowohl große Chancen als auch erhebliche Risiken. Einerseits kann KI die Effizienz und Genauigkeit juristischer Arbeiten erheblich steigern. Automatisierte Dokumentenanalyse, vertragliche Prüfungen und Recherchen können durch KI schneller und zuverlässiger durchgeführt werden als durch Menschen. Wie gruender.de berichtet, eröffnen diese Technologien neue Möglichkeiten für Kanzleien, ihre Dienstleistungen zu erweitern und qualitativ zu verbessern.

Auf der anderen Seite gibt es jedoch auch Risiken, die nicht unterschätzt werden dürfen. Fehlende menschliche Urteilsfähigkeit kann zu falschen Schlussfolgerungen und Entscheidungen führen. Zudem besteht die Gefahr, dass durch den Einsatz von KI die Vertraulichkeit und Datensicherheit von Mandanteninformationen gefährdet wird. Ein weiteres Risiko ist die Abhängigkeit von Technologien, die möglicherweise fehleranfällig oder manipulierbar sind.

Die Frage, ob KI eines Tages Juristen vollständig ersetzen könnte, ist ebenfalls Gegenstand intensiver Diskussionen. Während KI-Technologien in der Lage sind, viele Aufgaben schneller und kostengünstiger zu erledigen, bleibt die menschliche Expertise und ethische Entscheidungsfähigkeit unverzichtbar. Die Zukunft der juristischen Praxis wird wahrscheinlich eine Kombination aus menschlichen und KI-gestützten Prozessen sein, die die Stärken beider Ansätze vereint.

Daten- und Urheberrecht im Kontext von KI

Im Rahmen der Nutzung von KI-Tools stellen sich erhebliche Herausforderungen im Bereich des Datenschutzes und Urheberrechts. Datenschutz ist von zentraler Bedeutung, da KI-Systeme häufig große Mengen personenbezogener Daten verarbeiten. Dies erfordert strikte Schutzmaßnahmen, um sicherzustellen, dass die Daten nicht missbraucht oder unrechtmäßig weitergegeben werden. Die Datenschutz-Grundverordnung (DSGVO) der Europäischen Union setzt hierbei hohe Standards, die von Unternehmen und Organisationen eingehalten werden müssen.

Ein weiterer wichtiger Aspekt ist das Urheberrecht. KI-Systeme können kreative Inhalte erzeugen, was die Frage aufwirft, wem die Urheberrechte an diesen Inhalten zustehen. Laut einem Artikel von Vischer ist es essenziell, klare Regeln zu etablieren, um die Rechte von Autoren und Entwicklern zu schützen. Dazu gehört auch die Schulung von Mitarbeitenden, um sicherzustellen, dass sie die rechtlichen Rahmenbedingungen verstehen und einhalten.

Ein Beispiel für spezifische Schutzmaßnahmen ist die Anonymisierung von Daten, bevor sie von KI-Systemen verarbeitet werden. Zudem sollten Unternehmen transparente Richtlinien entwickeln, um sicherzustellen, dass die Nutzung von KI im Einklang mit den geltenden Gesetzen steht. WalkMe betont, dass es wichtig ist, regelmäßig Schulungen durchzuführen und Systeme zur Überwachung und Kontrolle der Datenverarbeitung zu implementieren, um rechtliche Fallstricke zu vermeiden.

Zukünftige Entwicklungen und regulatorische Maßnahmen

Der Bereich der Künstlichen Intelligenz entwickelt sich rasant weiter, und damit einhergehend wächst auch die Notwendigkeit, regulatorische Maßnahmen anzupassen und weiterzuentwickeln. Ein zentrales Ziel dieser Maßnahmen ist es, ein ausgewogenes Verhältnis zwischen Innovation und Schutz zu gewährleisten. Laut dem Anwaltsblatt besteht eine der größten Herausforderungen darin, sicherzustellen, dass die rechtlichen Rahmenbedingungen mit dem technologischen Fortschritt Schritt halten.

In Zukunft könnten neue Gesetze und Regulierungen eingeführt werden, um den Einsatz von Hochrisiko-KI-Systemen zu überwachen. Der EU Artificial Intelligence Act ist ein Beispiel für eine solche Initiative, die spezifische Anforderungen an die Transparenz, Sicherheit und Verantwortung von KI-Systemen stellt. Diese Regelungen sollen dazu beitragen, das Vertrauen der Öffentlichkeit in KI-Technologien zu stärken und gleichzeitig Innovationen nicht unnötig zu behindern.

Eine weitere zukünftige Entwicklung könnte die Einführung von ethischen Leitlinien für den Einsatz von KI sein. Diese Richtlinien könnten Unternehmen dabei unterstützen, verantwortungsbewusst und ethisch mit KI zu arbeiten und dabei die Interessen aller Beteiligten zu berücksichtigen. MIT Sloan hebt hervor, dass die Zusammenarbeit zwischen Regulierungsbehörden, Forschern und Industrie entscheidend sein wird, um effektive und nachhaltige Lösungen zu entwickeln.

Fazit und Handlungsempfehlungen

Die rechtlichen Aspekte der Nutzung von Künstlicher Intelligenz sind komplex und erfordern eine sorgfältige Betrachtung und Einhaltung der geltenden Gesetze und Vorschriften. Zusammenfassend lässt sich sagen, dass sowohl Datenschutz als auch Urheberrecht zentrale Themen sind, die bei der Implementierung von KI-Tools berücksichtigt werden müssen. Klare Regelungen und Schulungen sind unerlässlich, um rechtliche Risiken zu minimieren.

Unternehmen sollten proaktiv Maßnahmen ergreifen, um sicherzustellen, dass ihre KI-Systeme den rechtlichen Anforderungen entsprechen. Dazu gehört die regelmäßige Überprüfung und Aktualisierung von Datenschutzrichtlinien und die Implementierung von Schutzmaßnahmen, um die Integrität und Sicherheit der Daten zu gewährleisten. Laut dem Fortbildungsportal der Ruhr-Universität Bochum ist es zudem wichtig, dass Unternehmen transparente Prozesse und Richtlinien entwickeln, um das Vertrauen der Nutzer in KI-Technologien zu stärken.

Abschließend sollten Organisationen die Zusammenarbeit mit rechtlichen Experten in Betracht ziehen, um sicherzustellen, dass sie auf dem neuesten Stand der Gesetzgebung sind und um rechtliche Fallstricke zu vermeiden. Durch eine verantwortungsbewusste und rechtlich fundierte Nutzung von KI können Unternehmen nicht nur ihre Effizienz und Innovationskraft steigern, sondern auch das Vertrauen ihrer Kunden und Partner gewinnen.